Instagram alertera les parents si leurs adolescents recherchent à plusieurs reprises le suicide ou l'automutilation

Instagram enverra des notifications aux parents si les adolescents recherchent à plusieurs reprises du contenu sur le suicide ou l'automutilation. Voici comment fonctionnera la nouvelle fonctionnalité de Meta

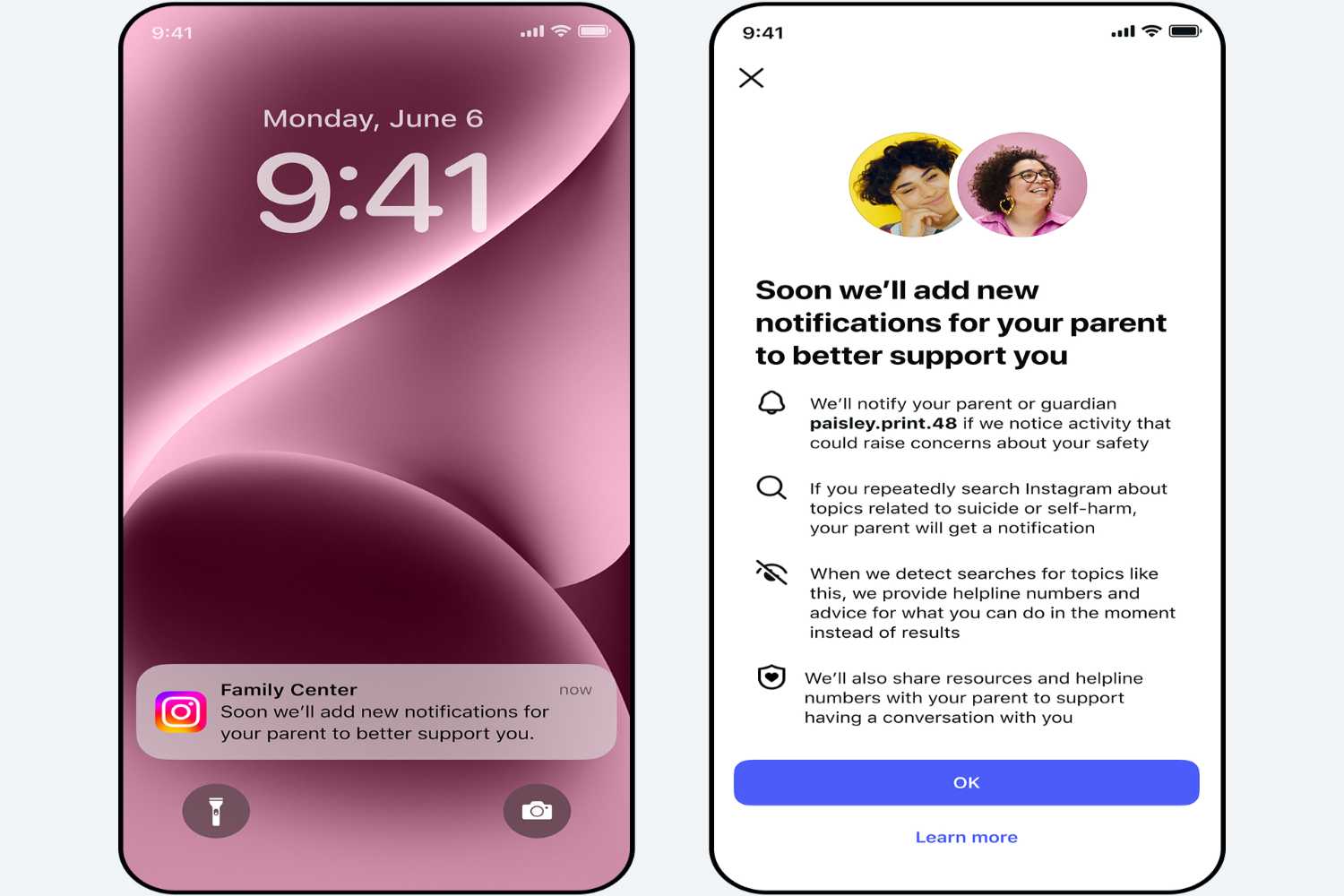

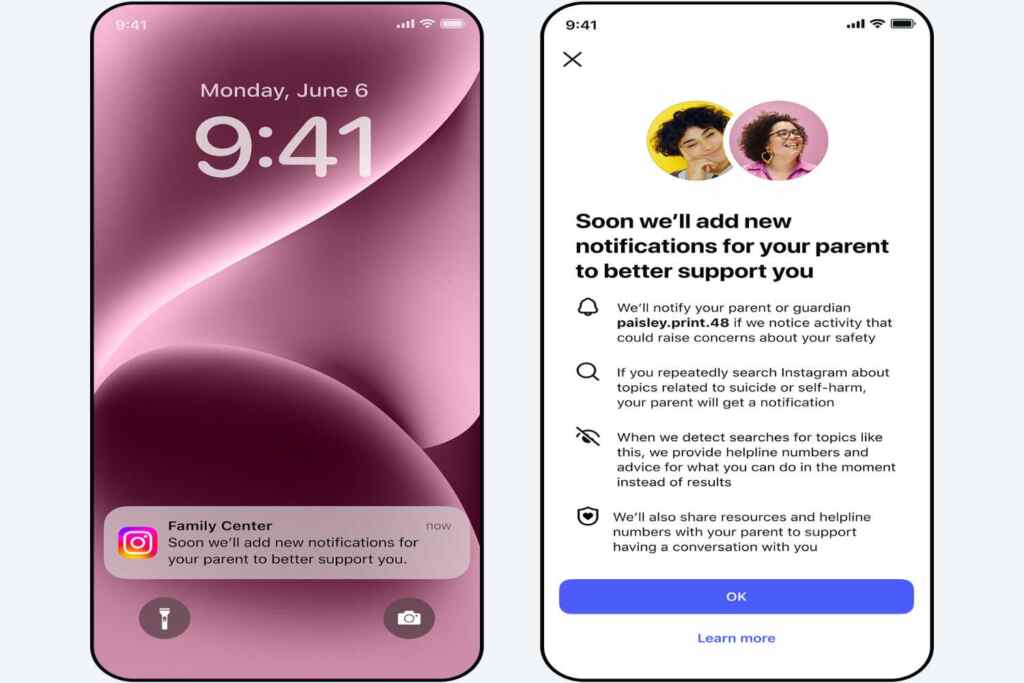

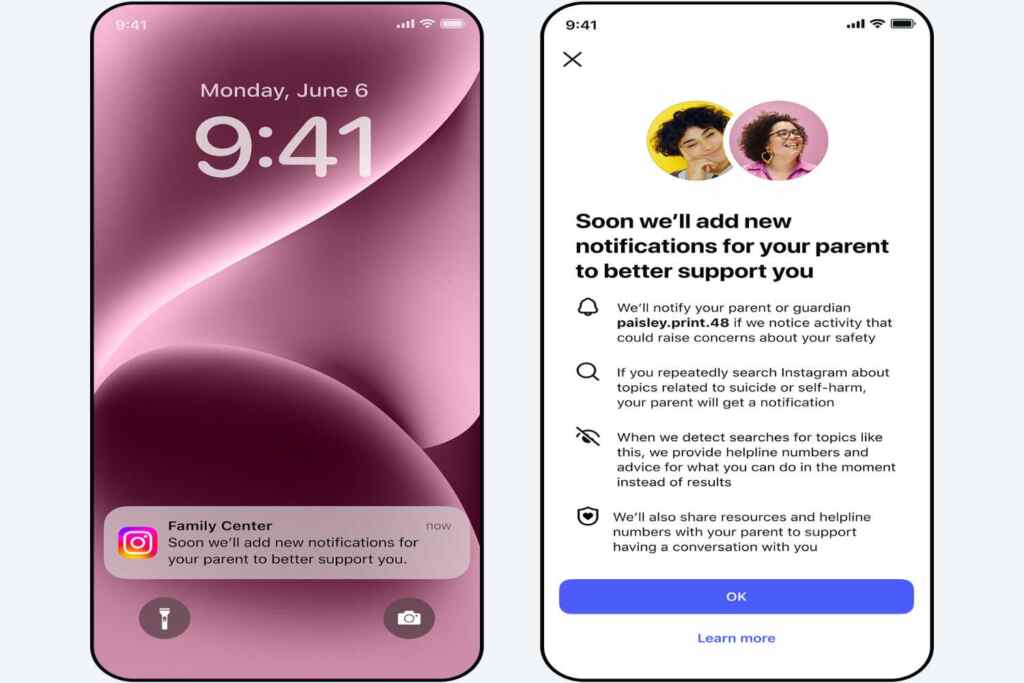

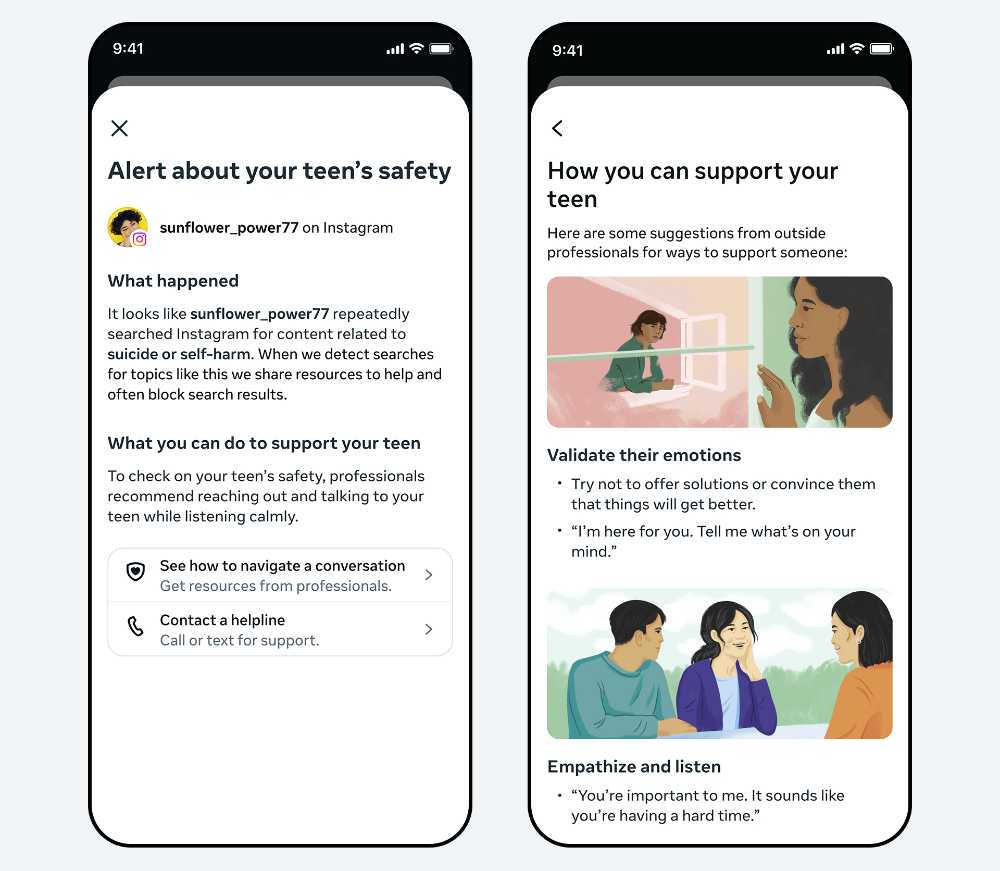

Meta a annoncé qu'Instagram commencerait à informer les parents lorsque leurs adolescents effectuent des recherches répétées sur des sujets comme le suicide ou l'automutilation sur une courte période de temps. Un message qui peut arriver via une application, un SMS ou même WhatsApp. Pas une simple notice technique, mais un signal d’alarme sur un sujet très délicat et plus que jamais d’actualité.

La nouveauté concerne les comptes d'adolescents connectés à un système de surveillance active. Seuls les adultes ayant choisi d'activer le contrôle recevront l'alerte. Il ne s’agit pas d’une surveillance généralisée, mais d’une option ciblée destinée à intercepter des situations potentiellement critiques.

Comment fonctionne la nouvelle protection

Le mécanisme est activé lorsqu'un mineur utilise fréquemment la fonction de recherche de contenus liés à l'automutilation. Dans ce cas, en plus du blocage automatique des résultats sensibles et de la redirection vers les ressources du support, une notification directe est envoyée sur le compte du parent.

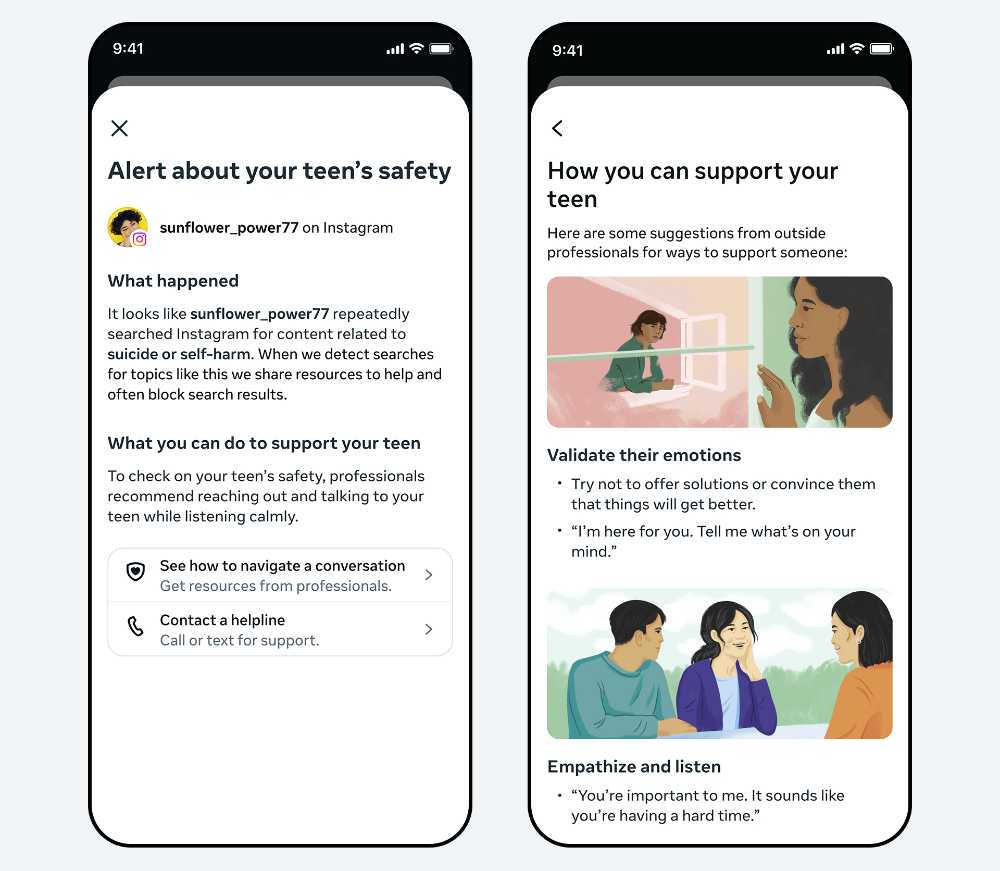

L'alerte ne signale pas seulement un comportement. Il sera accompagné de matériel d'information élaboré avec la contribution d'experts, conçu pour aider les adultes à gérer les conversations difficiles avec leurs enfants. L’objectif déclaré est de déplacer l’attention de la simple surveillance vers la prévention consciente. Le système sera initialement lancé aux États-Unis, au Royaume-Uni, en Australie et au Canada. D'autres pays, dont la France et l'Espagne, s'apprêtent à adopter des mesures similaires, tandis qu'une extension à d'autres zones est attendue dans les mois à venir.

De la recherche aux chatbots : le périmètre s’élargit

L'actualité ne s'arrêtera pas aux recherches de photos ou de bobines. Dans les prochains mois, les notifications passeront également par des interactions avec Meta AI, le chatbot intégré à l'écosystème de la plateforme. Un choix qui reflète une réalité désormais évidente : de nombreux adolescents, lorsqu’ils cherchent des réponses intimes ou douloureuses, se tournent vers les intelligences artificielles conversationnelles.

Le sujet est délicat. Selon une enquête rapportée par Reuters, les recherches internes de Meta ont montré que la présence de troubles de l'alimentation est élevée chez les adolescents régulièrement exposés à des contenus générant un inconfort avec leur corps. Un fait qui renforce la nécessité d’outils de protection plus incisifs.

Entre sécurité et responsabilité numérique

La nouvelle fonction fait partie d’une démarche plus large visant à protéger les jeunes utilisateurs. Instagram limite déjà l'accès aux contenus nuisibles et redirige vers les lignes d'assistance, mais avec cette étape, il introduit un élément supplémentaire : la coresponsabilité familiale.

Le débat sur la frontière entre protection et vie privée reste ouvert. Le message est cependant clair : face aux signes répétés de malaise, la plateforme a choisi de ne pas rester neutre. Dans un environnement numérique où les recherches peuvent être silencieuses et invisibles, une simple alerte pourrait se transformer en une vie sauvée.

Source : Méta